|

春节前后,网络和微信上有一篇长达3万余字的译文在流传,文章的标题是《为什么有很多名人让人们警惕人工智能?》。篇首有这样一段话:“人工智能很可能导致人类的永生或者灭绝,而这一切很可能在我们的有生之年发生。”上面这句话不是危言耸听,请耐心地看完本文再发表意见。

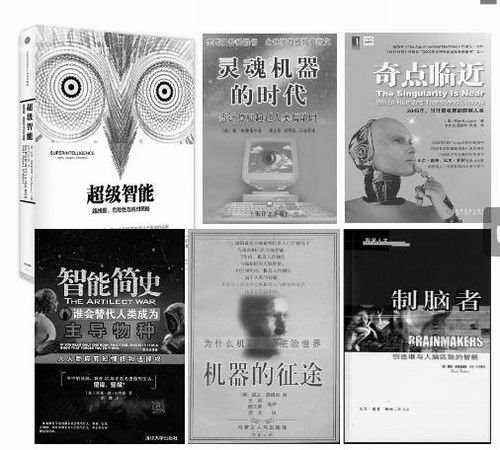

文中称,史蒂芬·霍金、比尔·盖茨等著名人士都发出了警告:如果智能机器缺乏监管,人类将迎来一个黑暗的未来。而美国特斯拉汽车公司首席执行官埃隆·马斯克则说:人工智能可能是我们面临的最大灭绝风险,创造人工智能犹如召唤一只恶魔。他预计“一些极为危险的事情即将发生”,最快将在5年内。 无机生命(机器)会发展出与有机体类似的生存和竞争意志吗?有朝一日当机器智能超越人类并不受人类控制时,我们将会遇到什么危险?类似这样的话题或场景,我们常常在科幻小说和科幻电影中遇到。近年来,也有越来越多的图书涉及。 较早出现也较有影响的是《机器的征途——为什么机器人将统治世界》一书([英]凯文·渥维克著,内蒙古人民出版社,1998),作者系英国雷丁大学教授、控制论与机器人研究专家。全书着眼于描述机器已发展得比人类更聪明的未来时代,并展示了第一批能够学习、互相交流和自我设计程序的机器人。作者感慨技术变革之快,恐怕将使得事物发展的结果非我们所愿意看到,甚至不能掌控。他断言:“在2050年,我们人类为机器所驱使,必须做机器规定我们做的事情……” 而随后出现的《制脑者:创造堪与人脑匹敌的智能》一书([美]戴维·弗里德曼著,三联书店,2001),倒没有什么悲观的色调。全书梳理了人类不断认识自身智能的历程和人工智能概念的源流,展示了人类创造人工智能所取得的一些里程碑式的成果。其中有:给机器上装上“大脑”;让机器人具有脑电波并具有不规则的思维活动;创造出一种新的电脑芯片,具有大脑细胞的功能…… 机器智能超越人类时的梦魇,随着《灵魂机器的时代:当计算机超过人类智能时》([美]雷·库兹韦尔著,上海译文出版社,2002)一书的出版,又一次萦绕在人们心头。该书出版于1999年,作者系美国著名的发明家和思想家,在书中他做出了惊人的预言:到21世纪初,地球上将出现一种足以与人类智能抗衡的新型智能,最终它将远远超过人类的智能。 库兹韦尔还想象,将来的类人智能体也能够拥有像意识、情绪这样的特质。 2005年,《奇点临近:2045年,当计算机智能超越人类》([美]雷·库兹韦尔著,机械工业出版社,2013)一书问世,并成为当年美国最畅销非小说类图书和亚马逊最佳科学图书。此书更为系统、全面地表达了库兹韦尔预测人工智能和科技未来的观点。特别是对“奇点”的概念和涵义进行了详细的阐释。他还预测了机器智能赶超人类智能之各个方面后发展的下一阶段:人类与机器的联合,即嵌入我们大脑的知识和技巧将与我们创造的容量更大、速度更快、知识分享能力更强的智能相结合。这种融合便是奇点的本质。 库兹韦尔的预言和观点在被广为传播的同时,也引起了极大的争议,乃至强烈的质疑。但库兹韦尔坚信自己的论断言之成理,一种“深刻的变化”必然会发生。而他所构想出的关于科技进化的理论——“加速回归理论”,能够解释为什么在宇宙的总体进化中,技术和进化将以指数的速度向前推移。这也贯穿着在过去的30年里他逐渐认识到的“一个重要的基本思想”:改变世界的思想力量其本身也正在加速。换句话说,并不只是科技在飞速地发展,“发展”本身也在不断地跃进。 人工智能机器的潜在智能是真实且巨大的——将是人类的万亿个万亿倍。或迟或早,科学会产生一种和人类一样运作的人工生命形式。人工智能问题(或者说物种支配问题)将主宰新世纪的全球政治。果真如此的话,那将是人类历史上最大的灾难,因为再也没有历史了,再也没有人类了。这是《智能简史——谁会替代人类成为主导物种》([美]雨果·德·加里斯著,清华大学出版社,2007)一书所表述的主要观点,其作者是用这样一句短语结束了本书:“我们是在制造上帝,还是在制造我们潜在的敌人?” 德·加里斯坦言他所从事的工作几乎让他精神分裂,并且带着很大的负罪感,“因为我认为我的工作就是问题的一部分。”凯文·渥维克在为《智能简史》一书所写的推荐序中则写道:“几十年后,如果德·加里斯关于‘物种主导问题将在本世纪主导全球政治’的言论被证实是正确的话,那么他将是21世纪最主要的思想家之一。” 自20世纪40年代计算机被发明出来之后,机器就一直被寄予厚望,人工智能的先驱者们大多数时候都不认为他们的事业可能会存在风险。英国数学家欧文·约翰·古德大概是清晰阐述人工智能未来图景的第一人,早在1965年他就指出: “我们把超智能机器定义为具备超越所有聪慧人类智能活动的机器。一旦机器设计成为一项智能活动,那么,超智能机器就能设计出更好的机器。毫无疑问,肯定会出现诸如‘智能爆发’这样的局面,人类智能会被远远地甩在后面。因此,第一台超智能机器将是人类制造的最后一台机器。” 目前人工智能方面存在的显著风险,便与前述“智能爆发”相关,所以我们必须以最严肃的态度审视之——《超级智能:路线图、危险性与应对策略》([英]尼克·波斯特洛姆著,中信出版社,2015)一书如是说。该书诠释了可能出现的超级智能带来的挑战,以及我们应该如何更好地应对。作者认为,这很可能是人类面对的最重要和最可怕的挑战;而且,不管我们成功与否,这大概都是我们将要面对的最后一个挑战。 更重要的一点或许在于,我们再不能以看待过去的视野,去理解必将超越它的事物了。

|  |联系我们|法律声明|用户协议|AMT咨询|商务合作|会员入驻|积分充值|积分商城|积分奖励规则|TradEx全球购|加入QQ技术群|添加企业微信|加入微信技术群|文章投稿|

世界先进制造技术论坛™(简称AMT™, 制造知网™)

( 沪ICP备12020441号-3 )

|联系我们|法律声明|用户协议|AMT咨询|商务合作|会员入驻|积分充值|积分商城|积分奖励规则|TradEx全球购|加入QQ技术群|添加企业微信|加入微信技术群|文章投稿|

世界先进制造技术论坛™(简称AMT™, 制造知网™)

( 沪ICP备12020441号-3 )